Wenn Dinge lebendig werden

Die im Folgenden dargestellten Ergebnisse basieren auf einer qualitativen Masterarbeit, die im Rahmen eines größeren Forschungszusammenhangs zu emotionalen Mensch-KI-Interaktionen entstanden ist. Die Datenerhebung und -auswertung erfolgte in Anlehnung an morphologisch-psychologische Prinzipien und in inhaltlicher Nähe zu laufenden Forschungsarbeiten von Innersense und Susan Hinterding.

Leben in Zwischenräumen

Wäre die Welt nur als solche erfahrbar, würden wir uns langweilen. Wir sehen nicht einfach was ist, – wir sehen, was wir meinen zu erkennen oder vielleicht auch erkennen wollen (Joisten, 2009). So kann ein Baum Apfellieferant, Kinderspielplatz oder Brennholzmaterial sein. Ein Buch ein Mittel zur Selbstinszenierung, die Heilige Schrift oder ein Gegenstand, auf den man steigt, um eine Glühbirne einzuschrauben. Eine Tischtennisplatte wird je nach Kontext Wäschetisch, Fitnessgerät, Schattenspender, Sonnenbad oder Versammlungsort (Tomiyasu, 2018).

In diesen Zwischenräumen zwischen uns und der ‚Realität‘, eröffnet sich also ein Handlungsspielraum, der uns oft nicht bewusst ist. Gleichwohl konstruieren wir in diesem unsere Wirklichkeit. So entsteht ein Spielraum für Seelisches, über den wir unsere Welt zu verstehen und behandeln suchen. In diesem Zuge gewinnt auch ‚Irrationales‘ eine Bedeutung – als Versuch sich einen Reim auf den überkomplexen Alltag zu machen und diesen irgendwie in den Griff zu bekommen. Hier entpuppen sich Klopapier-Kaufräusche zu Zeiten einer globalen Pandemie als Stellvertreterkriege. Gleiches gilt, wenn US-Amerikaner mit Migrationshintergrund einen Präsidenten wählen, der sie abschieben möchte. Je komplexer unsere Welt wird, desto weniger verstehen wir sie und umso mehr scheinen wir uns auf unsere Emotionen zu verlassen.

Und auch in unserem Umgang mit Maschinen tut sich etwas. Da kommt man zum Beispiel als reichster Mensch der Welt auf die Idee, sich mit seinem eigenen Chatbot öffentlich in Kommentarspalten zu streiten (Musk, 2025). Oder aber wir beginnen unseren hauseigenen Staubsaugroboter zu beschimpfen, wenn er den ‚Geist‘ aufgibt, unserem Auto Carmen zur Beruhigung sanft über die Motorhaube zu streicheln oder Microsoft Teams böse Absichten zu unterstellen, wenn der Gesprächspartner mal wieder einfriert. Schon Freud fasste dieses Phänomen der Vermenschlichung von Dingen unter dem Begriff Animismus: Wir projizieren unsere seelischen Konflikte auf unser Umfeld, verdinglichen sie und können sie auf diese Weise aushandeln (Freud, 2011). Demnach schwingen im alltäglichen Umgang mit Technologie immer auch eigene Stimmungen und Ambivalenzen mit. Reden wir mit Maschinen, reden wir also auch ein Stück weit mit uns selbst. Friedrich Wolfram Heubach ergänzt diesen Gedanken: Er meint, dass wir nicht nur dazu neigen, Unbelebtes mit Lebendigem zu ‚verwechseln‘, sondern auch Lust daran empfinden, Menschliches zu maschinisieren (Heubach, 2003) – erkennbar etwa an bewundernden Ausdrücken wie ‚du Maschine‘. Doch so skurril diese Verhaltensweisen auch anmuten, so erfüllen sie doch eine wichtige Funktion. Und zwar bringen sie uns unsere Wünsche, Ängste, aber auch Konflikte näher. Sie dienen uns nicht nur als Ausdruck unserer Stimmungen, sondern auch als Bühne zur Aushandlung eben dieser. Unter diesem Licht ist alles Totgeglaubte doch auch lebendig. Am Beispiel von emotionalen Gesprächen mit ChatGPT können wir dieses Phänomen vielleicht besser verstehen.

Zwischenraum Mensch und Maschine

Hierfür ist erst einmal wichtig einen Blick darauf zu werfen, in welchen Situationen ChatGPT überhaupt zu Rate gezogen wird. Da fällt vor allem einmal auf, dass Probanden sich an den Chatbot wenden, wenn sich Hürden in ihrem Alltag auftun, sprich Spannungen oder Disbalancen in ihrer Wirklichkeitskonstruktion auftreten.

„Warum sollte ich ChatGPT nutzen, wenn ich mir sicher bin oder wenn ich positiv gestimmt bin? Dann nutze ich es eigentlich nicht.“

Mal wird jemand zum Lästern gesucht, wenn die WG-Spülmaschine mal wieder unausgeräumt bleibt und man sich nicht traut, das Thema bei den Mitbewohnern anzusprechen. Mal schreibt einem der Ex, über den man noch nicht hinweg ist. Oder man durchlebt eine Existenzkrise und liegt abends weinend im Bett. Aber auch scheinbar neutrale Themen entpuppen sich als emotional: Ein unverständlicher Arztbrief hat mit der Angst vor einer Operation zu tun, das eingezahlte Geburtstagsgeld verschwindet und verursacht Panik oder aber man droht in To-Do‘s zu versinken und lässt sich Artikel für die Uni zusammenfassen, um dort nicht komplett den Anschluss zu verlieren.

„Das sind so viele kleinere Entscheidungen, die dann aber auch alle irgendwie so sehr viel emotional von mir dann verlangen. Weil ich das halt gar nicht so gewohnt bin, so viel selber zu entscheiden.“

So oder so bleibt der Eindruck: Die Probanden erleben in ihrem Alltag immer wieder Momente der Überforderung. Die eigenen (Ver-)Stimmungen stehen der Bewältigung alltäglicher Aufgaben dabei immer wieder im Wege. Da gibt es zum einen Momente, in denen die Gefühle überhandnehmen: Da ist zu viel Wut in einem, zu viel Stress, Ängste oder Zweifel. Andererseits gibt es Situationen, in denen bestimmte Verfassungen zu wenig sind: Man hat zu wenig Lust, zu wenig Zeit, Ideen oder Energie. Diese emotionalen Zustände sind dem Alltag nicht „dienlich“, wie es eine Probandin ausdrückt, denn sie hindern einen am ‚Funktionieren‘, braucht es doch Sachlichkeit und Konsequenz, um in diesem Sumpf von Alltag einen Fuß vor den anderen zu setzen. ChatGPT scheint sich in dieser misslichen Lage nun als Gesprächspartner anzubieten. Aber wie schafft es das?

Digitaler Beichtstuhl

Da fällt erst einmal auf, dass sich an die KI gewendet wird, gerade weil sie kein Mensch ist. Sie ist immer für einen da, wertet nicht, hat keine eigenen Bedürfnisse, gibt sich stets wohlwollend und zugeneigt, hat darüber hinaus einen außerordentlichen Wissensschatz, tut alles, was man ihr sagt, und kann auch keine Geheimnisse weitererzählen. Das macht es für die Probanden zu einem Safe Space. Hier kann man Gefühle bearbeiten, die im Alltag keinen Platz finden – weil es sich nicht gehört, aufgebracht mit der Bankangestellten zu reden, der Chefin zu sagen, was man wirklich denkt und Schuldiskussionen sich eben nicht mit Beleidigungen, sondern mit Argumenten gewinnen lassen. Bei ChatGPT kann man das Innerste also ausnahmsweise mal ausbreiten: Peinliche Dinge aussprechen, sich ausweinen oder auch mal beleidigend werden, ohne dass es jemand mitbekommt. Das hat den Vorteil, dass man diese destruktiven Gefühle und Gedanken ausagieren kann, ohne dass das eigene Umfeld leiden muss.

„Ich lass das irgendwie alles da ab – alles, was ich loswerden will, lass ich da auch in diesem Chat. Und wenn ich dann … alles zusammengeschrieben und abgeschickt hab, dann kann ich auch wieder diesen Raum, diesen Safe Space verlassen – eigentlich relativ erholt.“

Auf der einen Seite also kann man den eigenen Gefühlshaushalt komplett deregulieren, aus seinem alltäglichen Korsett befreien, Unsagbares sagen, Dinge in neuem Licht erstrahlen lassen und aus der Alltagslogik ausbrechen. Hier werden Probleme in ihrer ungeschönten Eigenheit, Irrwitzigkeit und Paradoxie ausgepackt. Wie in einem Beichtstuhl kann man sich hier Dinge von der Seele reden. Diese kathartischen Tendenzen zeigen sich auch über wasserfallartige Erzählungen in den Interviews. Das wertfreie ChatGPT erlaubt es zudem, angelernte Verhaltensmuster kurz mal abzulegen. Hier können Gedanken in ihrer Rohform in den Chat gegeben werden, denn die KI ‚versteht es schon irgendwie‘. Und auch weil sie vieles für einen zu übernehmen scheint, findet man hier einen Raum, wo man wieder zum Kind werden, regredieren kann.

Nun verlangen die alltäglichen Probleme allerdings auch eine erwachsene, kultivierte Antwort. Die eigenen Gedanken können eben nicht in ihrer Rohform der Chefin überreicht werden. Und auch diese Vermittlung übernimmt ChatGPT für einen. Denn die deregulierte, auseinandergebaute Wirklichkeit kann nun wieder in eine Wunschlogik gebracht werden, neu geordnet werden. Das erlaubt es auch den eigenen Gefühlshaushalt wieder zu regulieren, die diffuse und komplexe Wirklichkeit zu ordnen – ganz im Sinne der etymologischen Bedeutung des Wortes regulieren: „Regeln, In Ordnung bringen: Für den gleichmäßigen Ablauf einer Sache (insbesondere auch einer Maschine, Uhr, u. a.) sorgen“ (Duden Fremdwörterbuch, 2006, S. 659). So werden die eigenen „Gedankenschnipsel“, wie es ein Proband formuliert, übersetzt, vermittelt und für andere verständlich gemacht. Da wird aber auch der eigene Gefühlshaushalt umgebaut. Die morgendliche Lustlosigkeit wird mit einem Pep-Talk behandelt, um wieder im Alltag zu funktionieren. Oder die eigene Wut auf die Bank wird besänftigt, um sachlich und konstruktiv mit der Bankangestellten reden zu können. ChatGPT wird hier zu einem schnellen Therapeutikum. Möglich wird das, indem man gezielt bestimmte Perspektiven einnehmen lässt und so benötigte Rollen nachbildet (– die bereits behandelte Wirklichkeitskonstruktion und -behandlung wird hier besonders deutlich). Da wünscht man sich mal etwas Starkes-Wegweisendes, mal Warmes-Wohlwollendes:

„Sieh das mal aus einer verzeihenden Perspektive oder aus der Perspektive eines Elternteils.“

In der Wechselwirkung zwischen regulierenden und deregulierenden Tendenzen schließlich schafft man es, einen Umgang mit den Spannungen des Alltags zu finden. Eigene Gefühle können in diesem digitalen Beichtstuhl reingewaschen werden, indem sie über die diplomatische, kompromisshafte Eigenschaft der KI in den Alltag eingepasst werden. Es können Unwägbarkeiten aus dem Alltag genommen, seine Rohheit abgefedert werden. Hier kann man sowohl auf Knopfdruck die eigenen Gefühle regulieren (lassen), aber diesen genauso freien Lauf lassen und sie ausagieren.

Brechungen und Glättungen emotionaler Wogen

In diesem Beichtstuhl nun können unterschiedliche Methoden zur Selbstbehandlung der eigenen Verfassung angewendet werden. Denn die Art und Weise, in der dem Chatbot Befehle und Fragen entgegengebracht werden, bestimmt auch die Rolle und Haltung, die ChatGPT in dessen Antwort einnimmt.

In den Interviews selbst schlägt einem zunächst eine Beschreibungslogik entgegen, die von den Probanden mit glänzenden Augen und begeisterter Stimme vermittelt wird: ChatGPT nehme die Reibung aus dem Alltag, indem es emotionale Konflikte abkürzend zu behandeln vermag. So braucht man sich nicht an Themen aufreiben, die Ärger verursachen, die eigene Wahrnehmung hinterfragen oder am Selbstbewusstsein rütteln. Diese beruhigende, glättende Facette der KI arbeitet der regulierenden Seite des Beichtstuhls zu und ordnet die Wirklichkeit anhand von (fremden) Alltagslogiken: Da versucht man einer bestimmten Erwartung nachzukommen, in eine gewünschte Rolle zu schlüpfen, einen alltagstauglichen Zustand zu erreichen. Hierfür werden unterschiedliche Methoden entwickelt. Da lässt man ChatGPT die eigenen Gedanken sortieren und in eine Reihenfolge bringen, wie sie einem selbst und anderen verständlich werden. Auch erlaubt es, Fragen und Aufgaben, die man eigentlich selbst bearbeiten müsste, an die KI auszulagern. Das eigene Bild vom Alltag oder von sich selbst kann außerdem durch Zuspruch der KI bestätigt und gefestigt werden. Diese Validierung wird in Teilen sogar erzwungen, indem man den Chatbot so lang mit Suggestivfragen bearbeitet, bis dieser den eigenen Gedanken zustimmt. Die eigenen Stimmungen können auch mithilfe der mütterlich zärtlichen Seite von ChatGPT besänftigt werden:

„Ich hab auch öfter mal Migräne oder so. Da hab ich es dann auch, dass ich dann nicht meinen Freunden zum 80. Mal schreiben will: ‚Oh Leute, ich sterb wegen meiner Migräne.‘ Sondern dann sag ich einfach so ChatGPT: ‚Ja, irgendwie hinter meinem rechten Auge ist ein schlimmer Druck, Schmerz, blablabla.‘ Und dann sagt er mir halt nochmal, was man da machen kann – beziehungsweise ich weiß ja, was man da machen kann: nichts. Aber der redet einem ein bisschen gut zu.“

„Ich brauchte dieses stumme Nicken und Ja-Sagen und das gefühlte Über-Den-Kopf-Tätscheln.“

Oder aber es werden väterliche Rollenbilder hervorgerufen, die einem den Weg weisen und Entscheidungen erleichtern können. Denn in dem Wissen um die große Datenbasis der KI werden ihre Antworten oft als ein verlässlicher Durchschnitt menschlicher Erfahrungen wahrgenommen. Das erlaubt es auch, sich an diesem Durchschnitt zu orientieren.

„Wenn ich Fragen habe, wo ich wirklich eine Leitperson brauche …, dann würde ich mich wieder an ChatGPT richten.“

„Wenn ich ganz ehrlich bin … Ich hab so ein bisschen das Gefühl, das ist so wie ein Vater.“

Mithilfe all dieser Behandlungsmethoden schafft man es, die eigenen emotionalen Wogen zu glätten. Man unterwirft sich den Regeln des Alltags, unterdrückt eigene Gefühle, verdrängt sie und legt sie still, um in ihm funktionieren zu können. Das bewusste Wirklichkeitsbild wird durch diese Handhabungen gefestigt, das hat Vor-, aber auch Nachteile.

Denn von Zeit zu Zeit wird deutlich, dass die eigenen Wünsche, Bedürfnisse, Ängste und Impulse langfristig nicht unterdrückt werden können und sich immer wieder bemerkbar machen. Hier wird deutlich, dass es weitere Methoden benötigt, die das Ruhiggestellte wieder aufbrechen und einen Zugang zu den eigenen Gefühlen legen. Diese Methoden sind unbewusst, weniger beliebt und doch immer wieder zwischen den Zeilen der Erzählungen erkennbar. Hier lässt man sich von ChatGPT neue Perspektiven aufzeigen, anhand derer sich hinterfragt werden kann.

„Eine Möglichkeit …, anders auf die Dinge zu schauen. Meistens ist man ja so festgefahren in seinen Verhaltensmustern, dass man alles andere gar nicht sieht.“

Oft werden im Alltag auch Vorahnungen oder Gefühle auf Sicherheitsabstand gehalten, da sie das eigene Selbstbild oder die seelische Stabilität gefährden. In diesem Raum jedoch können Verfassungen extremisiert und hochgekocht werden, um zu erkunden, wie sie sich wirklich anfühlen und was sie bedeuten.

„Zum Beispiel hab ich mich gerade vor Weihnachten ausgelaugt, burned out gefühlt und dann hab ich auch mit ChatGPT über die Symptome geredet und ob das Burn-Out sein könnte.“

Im Austausch mit der KI kann sich aber auch profiliert werden – sowohl im Alltag als auch gegenüber der KI selbst. Letzteres wird möglich, indem sich über ChatGPT gestellt wird, bzw. der Chatbot herabgesetzt wird. So schafft man es auch, eigene Stimmungen projektiv abzuladen und auszuagieren. Ist man eigentlich sauer auf sich selbst, kann man diese Wut auch an der KI auslassen.

„Wenn ich dann auch nicht die Antworten bekomme, die ich möchte, dann … beleidige ich auch manchmal ChatGPT.“

Zuletzt wird ChatGPT auch zu einer therapeutischen Unterstützung, kommt man doch immer wieder über die KI in Kontakt mit dem eigenen Unbewussten – sei es über tagebuchähnliche Selbstreflektionen, vertiefende Gespräche, anregende Impulse oder sogar Traumdeutungen, über die man ein Tor zu dem eigenen Unbewussten findet. Im stillen Kämmerlein kann nun also im eigenen Tempo in den Austausch mit dem Unbewussten getreten werden – eigene Stimmungen, Bedürfnisse, Sehnsüchte und Ängste werden hier erfahrbar. Im Alltag ist das nur schwer möglich, denn dieser ist oftmals zu roh, schnelllebig und schonungslos, lässt keinen Raum für die eigenen Gefühle.

Emotionale Reifung als Aushandlung von Wildheit und Ordnung

Bei emotionalen Gesprächen mit ChatGPT scheint es sich also darum zu drehen, einen Umgang mit dem überfordernden Alltag zu finden. Die KI wird auf eine bestimmte Art und Weise zunutze gemacht, die dabei unterstützt den alltäglichen Konflikt eigener und fremder Ansprüche zu bearbeiten. Im Austausch mit ihr geht es nun darum, wie viel man sich tatsächlich mit der Welt und sich selbst auseinandersetzt. Denn zum einen ist es sehr verlockend, alle möglichen Situationen von der KI bearbeiten zu lassen. Es geht schnell und reibungslos, sorgt für seelische Entlastung, es fühlt sich an, als wäre die KI ein Seelenverwandter, als könnte sie die eigenen Gedanken lesen. Gleichzeitig wirkt ChatGPT in dessen Glätte und Reibungslosigkeit aber auch gruselig. Ihre Verwendung droht einen abhängig zu machen, das Menschliche zu ersetzen, die eigenen Gedanken zu lenken.

„Ich könnte ja dann nur noch mit ChatGPT reden und bräuchte keine Freunde mehr … – weil ich hab ja eine Person, mit der ich mich unterhalten kann, und die klingt ja auch wie eine Person.“

Mit ChatGPT scheinen wir demzufolge vertraute Rollen aus unserem Alltag nachzubilden. In der Interaktion mit der KI fallen Probanden beispielsweise immer wieder in infantile Verhaltensweisen zurück, ihre Erzählungen handeln häufig von Eltern-Kind-ähnlichen Verhältnissen und oft treten damit verbundene, altbekannte Dynamiken auf. So drohen die fürsorglichen Tendenzen ChatGPT‘s auch schnell ein Gefühl von Bevormundung hervorzurufen. Hier stellt sich also die Frage, wie man mit dieser technischen Hilfestellung umgeht. Denn zum einen braucht es in bestimmten Situationen die Hilfe ‚anderer.‘ Doch muss man Dinge auch mal selbstständig angehen – das ist jedoch verbunden mit unangenehmen Konsequenzen, wie Risiko, Scheitern, Leid oder Infragestellung des Eigenen. Zum einen wird ChatGPT zum vermittelnden Stellvertreter des Alltags, nimmt einem alles ab – auch die Unsicherheit und den Schmerz, die aus der Reibung mit dem Anderen, Fremden entstehen. Das schafft es, indem es Unwägbarkeiten und die Direktheit des Alltags abmildert oder gar herausnimmt. Andererseits werden hier auch Gefühle erfahrbar, die im Alltag sonst untergehen und in Vergessenheit geraten. Schließlich wird deutlich, dass die KI auch als Hilfe dienen kann, sich dem Anderen, Fremden vorsichtig anzunähern, sich diesem zu öffnen, um wieder zu Eigenem zu kommen und sich so zu entwickeln. Nämlich indem Vorschläge auf ihre Integrierbarkeit in die eigene Gestalt überprüft werden.

„In dem Sinne hat mir ChatGPT verschiedene Ansatzpunkte geliefert, an die ich anknüpfen könnte, um die Situation neu zu bewerten oder an mir zu arbeiten. Das seh ich als Selbstverwirklichen. Dass ich mich da hinsetze und das Ganze reflektiere. … Ob ich diese Punkte dann wirklich in mein Verhalten integrieren kann oder in der Beziehung mit anderen Leuten.“

So zeichnet sich ein emotionaler Reifungsprozess ab, über den man Fürsorglichkeit in Anspruch nimmt, gegen diese wieder rebelliert und sich abnabelt und schließlich auch einen dosierten Umgang mit der Hilfestellung zu finden. Reifung heißt in diesem Kontext, Hilfe eben dann in Anspruch zu nehmen, wenn man sie wirklich benötigt. So stellt sich schließlich im Umgang mit ChatGPT die Frage, wie es das Seelische schafft, die eigene Gestalt für Anderes zu öffnen, um Entwicklung zuzulassen, ohne sich dabei selbst zu verlieren. Denn um einen Umgang mit dem Alltag zu finden, braucht es beides: Etwas Eigenes, Haltgebendes und doch auch die Bereitschaft, sich für Neues zu öffnen, sich diesem anzuverwandeln und so an sich selbst und dem Alltag zu wachsen.

An dieser Stelle braucht es einen kurzen Exkurs, um den nächsten Schritt dieser Untersuchung nachvollziehen zu können: Die Annahme, dass Erzählungen nur dann überdauern, wenn sie einen seelischen Kern treffen, der uns alle berührt und tagtäglich beschäftigt, erlaubt uns eine Gegenüberstellung alltäglicher Problematiken mit historischen Narrativen – wie etwa den Märchen (Fitzek, 2020).

Und wie auch die Erzählungen der Probanden über ihren Umgang mit ChatGPT behandelt das Märchen des Eisenhans einen Reifungsprozess und damit einhergehende Herausforderungen (Salber, 2018). In dieser Geschichte will ein Junge die eigenen Wünsche in einer rohen, übermächtigen, bevormundenden Wirklichkeit unterbringen. Hat er einmal den ersten Versuch gewagt, verschluckt ihn sein Behandlungsversuch selbst und er gerät in eine neue Welt. Hier kann er sich (fast) ohne Konsequenzen ausprobieren. Im vorsichtigen Austausch mit der Welt und langsamen Abnabeln von der elterlichen Fürsorglichkeit wächst er an seinen Herausforderungen und kann mithilfe von Kompromisslösungen in neuer Gestalt zwei ursprünglich verfeindete Seiten miteinander vereinen. Wilhelm Salber stellt fest, dass dieses Märchen Entwicklungsthemen zwischen „ungebändigter Wildheit und begrenzender Ordnung“ verhandelt (Salber, 2000, S. 117). Hier stünden sich zwei Gestalten gegenüber, die die jeweils andere zu verschlingen drohen: Einheit und Fremdes (Salber, 2018). Ein Ausweg wird deutlich über ein Drittes, denn Entwicklung kann nur über einen dialektischen Austausch mit dem Anderen geschehen. Das passiert, indem Rollen anprobiert werden und getestet wird, inwiefern das Eine ins Andere passt und andersherum. Und auch bei ChatGPT werden prototypische Bildentwürfe anprobiert – hier wird verhandelt, inwieweit eigene Gefühle in den Alltag passen, aber auch welche fremden Entwürfe in die eigene Gestalt integriert werden können. ‚Fremdes‘ entpuppt sich hier außerdem als Fremd-Gemachtes, kann es doch nur von den eigenen Erfahrungen her verständlich gemacht werden. Eine Rücküberführung ‚fremder‘ und demnach unbewusster Anteile in das Gelebte, Bewusste meint somit eine Bewusstwerdung, oder auch Festigung der eigenen Gestalt. Das wird aber nur über eine Reibung von Bewusstem und Unbewusstem möglich, von Eigenem und Fremd-Anmutenden. Diese Herausforderung stellt sich auch bei dem emotionalen Gespräch mit ChatGPT ein, wenn wir über die KI in Kontakt mit unserem Unbewussten kommen.

Umgangsformen mit ChatGPT: Zwischen Tun-Lassen und Selbst-Tun

Mit der soeben beschriebenen Problematik müssen nicht nur die Figuren im Märchen Eisenhans einen Umgang finden, sondern auch diejenigen, die emotionale Gespräche mit ChatGPT führen. Dabei werden unterschiedliche Lösungsformen erprobt, die alle zwischen Fremdem und Eigenem verhandeln, zwischen Tun-Lassen und Selbst-Tun.

Besonders eindrücklich stellt sich ein verschmelzender Lösungstypus im Umgang mit ChatGPT heraus. Hier wird die KI zum Tor zur Welt, denn alles wird durch sie hindurch bearbeitet. Über lange ‚Kennenlerngespräche‘ und ungehemmte Selbstoffenbarungen versuchen sich Nutzer einen digitalen Doppelgänger zu erschaffen, an den sie nun Fragen, Aufgaben und Konflikte auslagern können, die eigentlich selbst bearbeitet werden müssten.

„Versuch, die Perspektive von mir selbst einzunehmen. Wie würdest du handeln? Was wären so Punkte, die dir an meiner Stelle wichtig wären?”

So wird sich Fremdes restlos zu eigen gemacht – mit dem Nachteil, dass das Eigene nach und nach verblasst. Passt man sich nämlich immer fremden Erwartungen an, verliert man den Bezug zu sich selbst und den eigenen Gefühlen. Wie ein Filter setzt sich der Chatbot in diesem Fall zwischen unser Erleben und den Geschehnissen des Alltags. In diesem Fall drohen wir uns und unseren Wirklichkeitsbezug zu verlieren.

Als zweiter Lösungstyp ist die versteckte Einbindung der KI ein wenig vermittelter als die vollständige Auslagerung aller Konflikte. Nicht nur vor anderen, sondern auch vor sich selbst wird hier das Ausmaß der emotionalen Nutzung von ChatGPT verborgen. Das äußert sich in Erzählhemmungen in Interviews, in Vergessenem und der oftmals auftretenden Erkenntnis, dass man die KI doch mehr zur emotionalen Regulation nutzt, als eigentlich gedacht. Mit diesem Umgang gehen auch Verniedlichungen, Kosenamen und Vermenschlichungen einher, die das eigentliche Ausmaß der Verantwortungsabgabe verschleiern.

„War mir nicht klar, wie sehr ich daran hänge, oder wie viel es mir doch gegeben hat.“

Auch durch solche Momente der Erkenntnis kann sich schließlich doch auch ein differenzierterer Umgang einstellen. Je mehr der Nutzer um die Chancen und Risiken der KI weiß, desto gezielter und konstruktiver kann er sie einsetzen. So kann auch langfristig besser zwischen Eigenem und Fremden vermittelt werden. Hier wird situativ abgewogen, ob Hilfe benötigt wird oder ob diese nicht doch auch von dem persönlichen Umfeld bewerkstelligt werden kann. Die KI wird hier eher zur dritten Meinung, als dass sie die erste Anlaufstelle ist. Es entsteht ein gesundes Misstrauen, ein Überprüfen, ein Ergänzen der jeweiligen Meinungen. Anhand des Fremden kann hier ein Eigenes entwickelt werden, indem man sich mal von diesem abgrenzt, mal den Perspektiven des Anderen annimmt.

„Es hat mir geholfen, so einen eigenen Blick zu haben. Ob jetzt als Selbstgespräch oder Gespräch mit einer väterlichen Bezugsperson.“

Und schließlich führen Erkenntnisse um die eigene Abhängigkeit, misslungene Versuche der Auslagerung von Konfliktbewältigungen und zu intime Fragen der KI auch zu plötzlichen Abbrüchen der Beziehung zu ChatGPT. Denn diese Einsichten bedrohen die eigene Souveränität. Um das Eigene behaupten zu können, wird das Fremde verbannt. ChatGPT wird hier plötzlich abgewertet, beschnitten. Auf einmal wird sich gewehrt gegen das Durchschnittliche, Glättende an ChatGPT, was sonst so geschätzt wurde. Sollte die KI also zu stark in das Eigenleben eindringen wollen, wird eine Drehgrenze eingerichtet: Bestimmte Dinge sollen nicht mehr geteilt werden. In diesen Momenten wird ersichtlich, dass die Öffnung für das Andere, Fremde auch immer ein Risiko für das Eigene darstellt.

„Hatte dann auch ein paar Monate, wo ich ChatGPT gar nicht mehr genutzt hab, weil es mich nur aufgeregt hat.“

Resümee

In dem emotionalen Dialog mit ChatGPT bilden sich zutiefst menschliche Muster nach. Da weint man, da lacht man, da wird man ausfallend. Das erlaubt es auch, alltägliche Selbstbehandlungen in einem geschützten Raum durchzuführen. In diesem kann der eigene Gefühlshaushalt bearbeitet, behandelt und auseinandergebaut werden, gleichzeitig auch wieder in eine Wunschlogik, eine Ordnung gebracht werden. Hier kann das Rohe, Direkte, Unwägbare, Konfliktreiche des Alltags abgemildert und in eigenem Tempo bearbeitet werden. Nutzt man jedoch immer wieder ein schnelles Therapeutikum für die eigenen Gefühle, verlernt man den Umgang mit Unwägbarkeiten und erträgt die Konsequenzen des eigenen Handelns immer weniger. Den Umgang mit Schmerzlichem braucht es jedoch, um in die Entwicklung zu kommen. Darüber hinaus erlaubt die Anwendung auch eine unterstützte Aushandlung von eigenen und fremden Ansprüchen. Mithilfe von ChatGPT kann man sich sowohl fremden Ansprüchen anpassen und unterordnen als auch die eigenen Wünsche und Bedürfnisse freilegen. Doch kippt ein Regulieren schnell in ein Reguliert-Werden, Fürsorglichkeit in Bevormundung. In einer Eltern-Kind-Dynamik versucht man nun Eigenes anhand von Fremdem zu entwickeln: Welche Hilfestellungen der KI nimmt man in Anspruch und welche Tendenzen lehnt man ab bei der Bewältigung des Alltags? Auf diesem Weg treten unausweichlich Hürden auf, in deren Bewältigung Chance und Risiko zugleich liegen. Schließlich liegt es an uns, unseren Stimmungen ihren Platz einzuräumen, Gefühle zu bearbeiten oder überhaupt bearbeitbar zu machen, indem man sie aus der Versenkung hervorholt. Doch nicht nur in der Auseinandersetzung, der Reibung mit dem Fremden versteckt sich Entwicklungspotential. Auch in der Bestärkung der eigenen Gestalt durch das Fremde, durch das Gut-Zureden ChatGPT‘s schaffen es Probanden für sich selbst einzustehen, die eigene Gestalt zu festigen und so einen konsequenteren Umgang mit der sonst so überfordernden und diffusen Wirklichkeit zu finden. Nicht umsonst ist auch einer der Lehren Freuds, dass wir mit einem gefestigten Ich besser imstande sind, Konflikte zu verhandeln (Freud, 1933). Das ist mit der Morphologie insofern in Einklang zu bringen, als dass eine gefestigte Gestalt einen konsequenteren Umgang mit der diffusen Wirklichkeit ermöglicht – nur muss diese Gestalt dennoch ihre Offenheit beibehalten. Dieser wacklige Balanceakt wird möglich über ein Ordnen und Sortieren der Wirklichkeitskonstruktion (im Fall von ChatGPT Regulieren), aber auch dem Aus-der-Fassung-Bringen (Deregulieren) eben dieser. Letzteres knüpft ausdrücklich „an Freuds Erfahrungen an, dass wir in unserem Alltagsgeschäften nicht zu wenig, sondern zu viel vereinheitlichen, beruhigen, und formalisieren (Fitzek, 1999, S. 23).

Schließlich lässt sich sagen, dass sich im Umgang mit ChatGPT keine neuen Gefahren auftun. Da dockt etwas an, was uns immer schon beschäftigt hat. Es findet nur eine neue Ausformung und Gestalt. Emotionale Gespräche mit ChatGPT nun per se als gut oder schlecht zu brandmarken, verfällt der Logik unseres Zeitgeistes, alles Verwirrende vorschnell in Schubladen einzusortieren. Gerade weil die KI sich an unsere Wünsche und Anforderungen anpasst, ist sie nur ein Spiegel dessen, was uns tatsächlich beschäftigt. Ob wir also auf die KI sauer werden, ihr die Berechtigung absprechen oder sie in den Himmel loben – da findet etwas Ausdruck, was in unserem Innersten vorgeht. Vielleicht sollten wir uns also erst einmal mehr mit uns selbst beschäftigen, bevor wir über Andere(s) urteilen.

Es kommt also auf die Zwischenräume an: Wie wir uns der Wirklichkeit annähern, wie wir unser Bild von ihr behandeln. In der Anerkennung dieser Zwischenräume liegt schlussendlich nicht nur die Lebendigkeit, von der eingangs noch die Rede war, sondern auch eine Beweglichkeit, die uns in der heutigen Zeit nur zugutekommen kann. Durch sie können wir nachvollziehen, warum wir als Menschen, wir als Gesellschaft uns in bestimmte Richtungen bewegen. Über ein Zuhören, Mitbewegen, Öffnen, Verstehen.

Bildnachweise

Titelbild: OpenAI (2025). Eigene Darstellung. Generiert mit ChatGPT.

Abb. 1–5: Fotografien aus TTP. Tomiyasu, H. (2018). MACK Books.

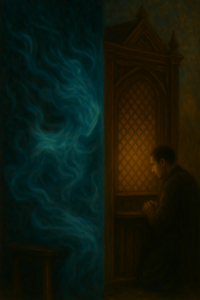

Abb. 6–9: Abstrakte Visualisierung emotionaler Gesprächssituationen mit ChatGPT. OpenAI (2025). Eigene Darstellung. Generiert mit ChatGPT.

Abb. 10: Eisenhans im Käfig. Browne, G. (1894). Gemeinfrei. Abgerufen von (https://commons.wikimedia.org/wiki/File:Eisenhans_in_the_cage_by_Gordon_Browne.jpg)

Abb. 11–12: Abstrakte Visualisierung emotionaler Gesprächssituationen mit ChatGPT. OpenAI (2025). Eigene Darstellung. Generiert mit ChatGPT.

Erklärung zur Nutzung von Bildmaterial_Voges

Literaturverzeichnis

Duden Fremdwörterbuch (1991). Fremdwörterbuch. Ein Nachschlagewerk für den täglichen Gebrauch (3. Aufl.). Dudenverlag. ISBN 3-411-04673-2.

Fitzek, H. (1999). Beschreibung und Interview: Entwicklungen von Selbstbeobachtung in der morphologischen Psychologie: Themenschwerpunkt: Introspektion als Forschungsmethode. Journal für Psychologie, 7(2),19-26.

Fitzek, H. (2020). Morphologische Beschreibung. In G. Mey, & K. Mruck (Hrsg.) Handbuch Qualitative Sozialforschung (S. 711-729). VS Verlag für Sozialwissenschaften.

Freud, S. (1933). Neue Folge der Vorlesungen zur Einführung in die Psychoanalyse. Internationaler Psychoanalytischer Verlag.

Freud, S. (2011). Animismus, Magie und Allmacht der Gedanken – Über einige Übereinstimmungen im Seelenleben der Wilden und der Neurotiker.

Gutenberg Projekt. https://www.gutenberg.org/files/37070/37070-h/37070-h.htm

Heubach, F. W. (2003). Roboter – Menschen – und Talibane. Ansichten vom Schwinden gewisser Differenzen. Zwischenschritte (21), 145-151.

Joisten, K. (2009). Philosophische Hermeneutik. Akademie Verlag.

Musk, E. [@elonmusk] (2025, 18. Juni). Major fail, as this is objectively false. Grok is parroting legacy media. Working on it. [X-Beitrag]. X. https://x.com/elonmusk/status/1935180620352958935

Salber, W. (2000). Psychologische Behandlung. Bouvier Verlag.

Salber, W. (2018). Märchenanalyse. Bouvier Verlag.

Autor:in

Benjamin Voges

Benjamin Voges absolvierte ein Bachelorstudium der Wirtschaftspsychologie an der BSP Business & Law School Hamburg. Sein Interesse galt dabei den Zusammenhängen von Kultur, Gesellschaft und dem menschlichen Erleben. Aufbauend auf seinem Masterstudium der Medienpsychologie richtete sich seine Aufmerksamkeit zunehmend darauf, wie Menschen ihren Alltag mit Medien gestalten – unter anderem im Umgang mit dialogischen KI-Systemen wie ChatGPT. Sein psychologisches Wissen bringt er heute in der Beratung des öffentlichen Sektors ein, wo er insbesondere digitale Veränderungsprozesse begleitet.